生成模型学习-文本生成相关

随着chatgpt的火爆,本文跟随前辈步伐在文本生成方面作初步的介绍,供大家了解。

AIGC 背景介绍

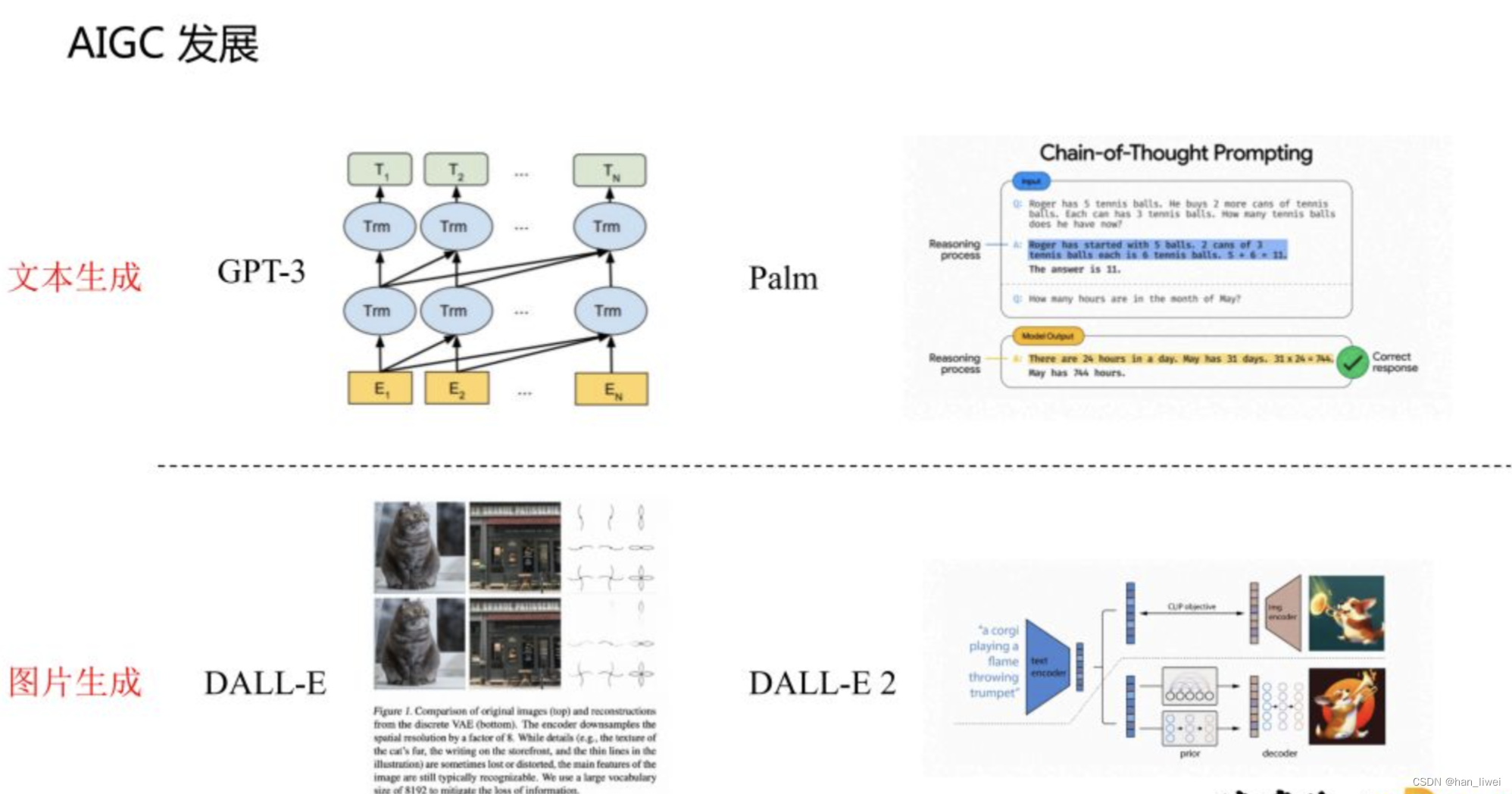

AIGC 的成功开始于 OpenAI 提出的 GPT-3。之前没有预训练的生成模型效果和现在有差距,即使用监督学习 + fine-tune 的方式可以在某些 task 得到不错的效果,但是它的泛化能力比较差,因此当时的 AIGC 并没有被大家关注。所以当 OpenAI 提出的 GPT-3 可以根据 Prompt 提示词或者 instruction 指令去生成代码以及各种各样的文本时,大家才开始更多去关注和探索 AIGC 方向。另外,除了文本生成以外,DALL-E 和 DALL-E2 在图片生成方面的进展也是推动 AIGC 发展的重要因素。

本次分享主要关注文本生成,下面回顾一下文本生成发展的过程。

最早的生成是 Encoder-Decoder 架构,没有预训练,只是做一些任务上的 fine-tune 工作,当时效果比较差。随着 GPT-1 预训练的提出才开始有不错的效果,之后 BART 和 T5 这两个模型提出之后发现,用一个生成模型可以做很多 task,而且这些 task 其实效果都可以比较好。比如 T5 可以把各种不同的 NLP 任务都转化成生成的方式。AliceMind 在 20 年的时候自研了一个 PALMÿ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2017

2017

暂无认证

暂无认证

CSDN-Ada助手: 推荐 Python入门 技能树:https://edu.csdn.net/skill/python?utm_source=AI_act_python