来自今天的爱可可AI前沿推介

[AS] Language Models are Drummers: Drum Composition with Natural Language Pre-Training

L Zhang, C Callison-Burch

[University of Pennsylvania]

基于自然语言预训练的鼓点生成

要点:

-

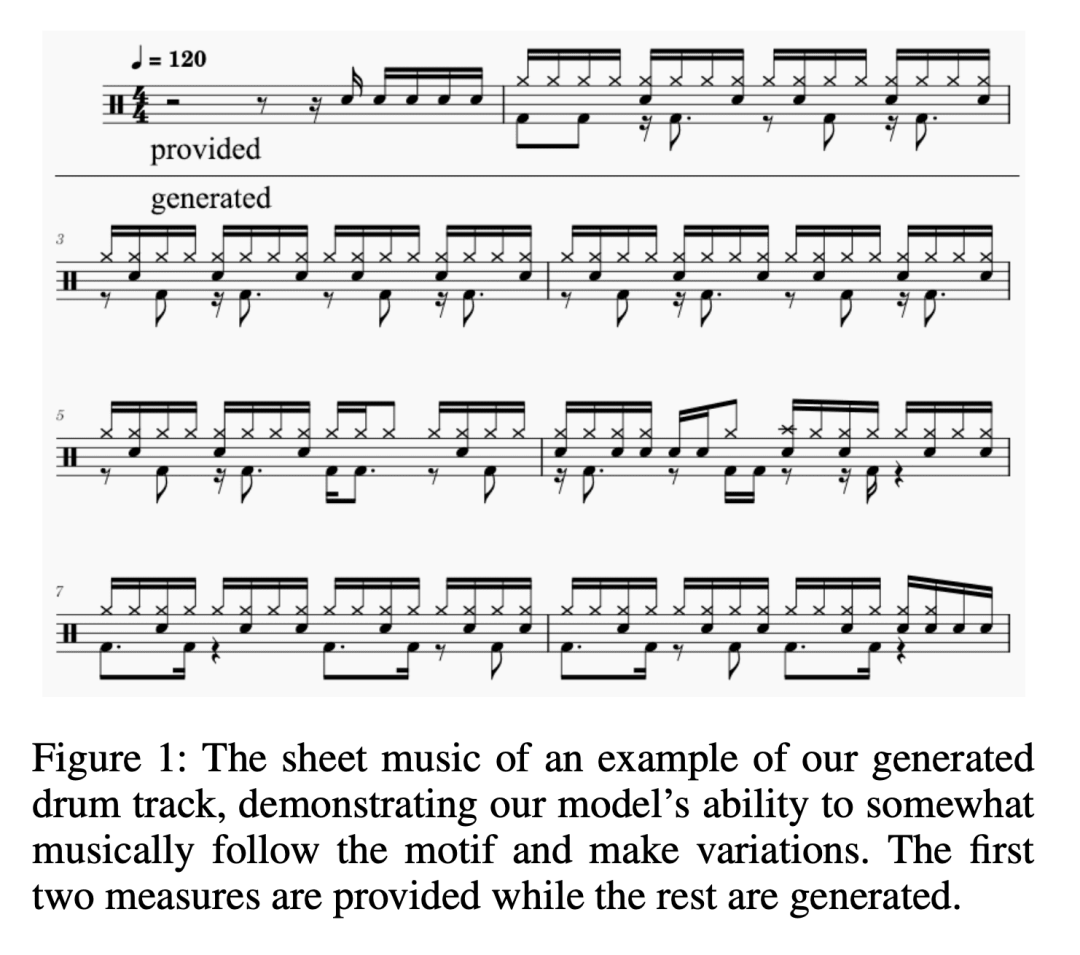

通过微调大型语言模型(LLM)在大量文本语料上预训练,可以从语言迁移到音乐知识; -

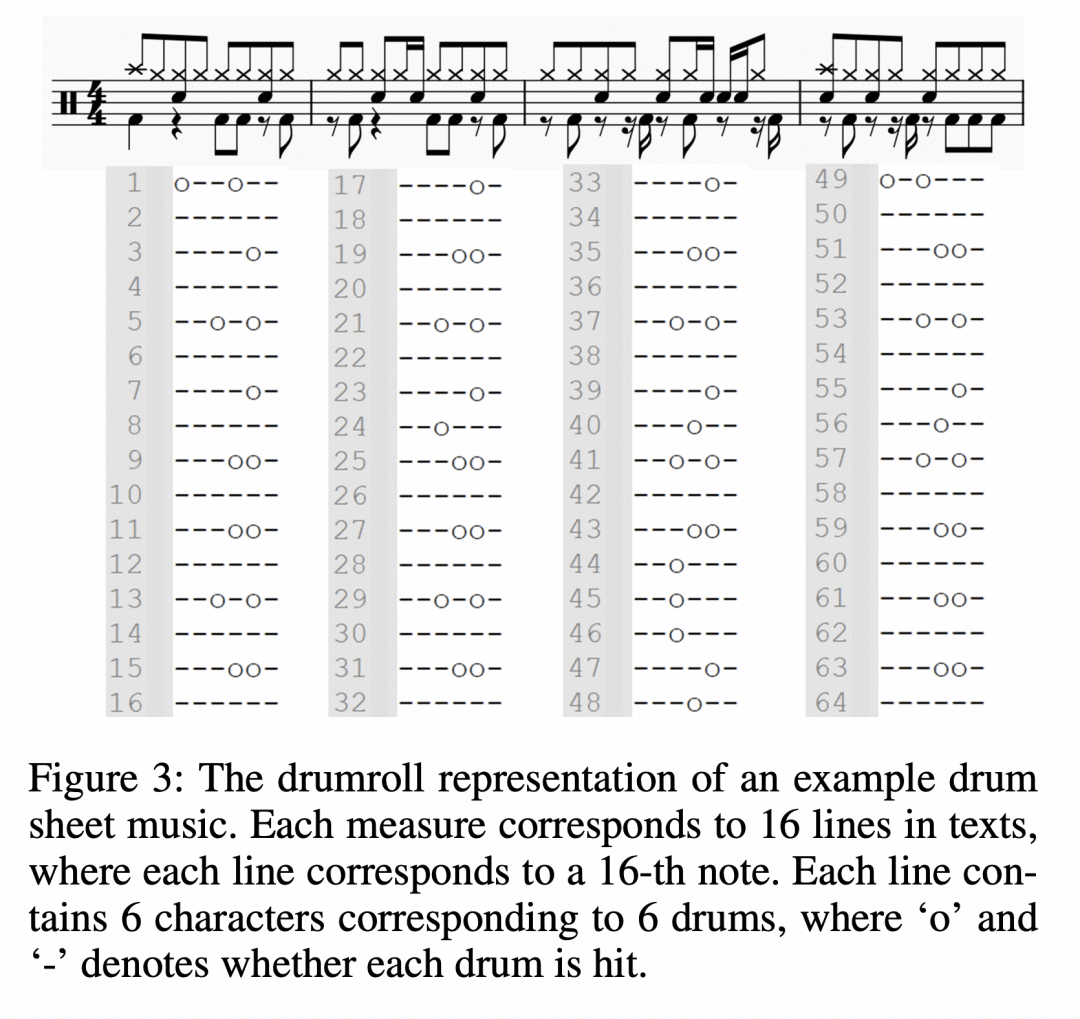

用GPT3在仅数百个MIDI文件(包含数百首鼓点演奏)上微调,可以产生合理的鼓点节奏; -

不进行语言预训练的模型(Transformer)没有类似的能力,只能进行简单重复; -

为了评估生成的音乐,提出一种专门针对鼓点的评估方法,以定性和定量方式评估机器生成的鼓点与人类演奏间的优劣。

一句话总结:

大型语言模型可以通过从文本语料库和少量音乐文件进行迁移学习来生成合理的鼓点,其能力得益于语言预训练; 提出了一种针对鼓点的评估方法。

论文链接: https://arxiv.org/abs/2301.01162

评论

沙发等你来抢